Secondo una ricerca svolta da ricercatori italiani, i moderni algoritmi consentono ai computer di interpretare concetti emotivi attraverso l’analisi delle immagini

Sono sempre di più gli ambiti in cui l’intelligenza artificiale trova impiego. Per esempio, può automatizzare i flussi e i processi di lavoro, ma anche lavorare in modo autonomo e indipendente da un team umano. La tecnologia consente infatti ai computer di simulare capacità umane come apprendimento, ragionamento e adattamento. Attraverso algoritmi avanzati e l’analisi di grandi quantità di dati, l’Ai è così in grado di riconoscere schemi, fare previsioni e prendere decisioni autonome. Nella prospettiva delle potenzialità dell’intelligenza artificiale, ad aprire nuovi molteplici e interessantissimi scenari è ora la ricerca condotta da Zaira Romeo, dell’Istituto di Neuroscienze del Cnr, e Alberto Testolin, dei Dipartimenti di Psicologia generale e di Matematica dell’Università di Padova. I ricercatori hanno infatti dimostrato attraverso un test con le fotografie che l’Ai capisce le emozioni dell’uomo.

Come si è sviluppato lo studio

“Date le sempre più impressionanti capacità dell’Ai in numerosi domini – spiega Zaira Romeo – con Alberto Testolin, che è anche mio marito, ci siamo chiesti se questi modelli “multimodali” (così sono chiamati tecnicamente le piattaforme di intelligenza artificiale, ndr) fossero addirittura in grado di fornire giudizi affettivi ad immagini che rappresentavano diversi tipi di contenuto emotivo. Abbiamo quindi sfruttato un database di scene visive creato da colleghi dell’Università di Varsavia per scopi di ricerca, per le quali erano già disponibili i corrispettivi giudizi affettivi forniti da un campione di persone. Essendo un database privato, l’Ai non aveva mai visto queste scene visive durante il processo di addestramento”.

Tutto è nato mentre Alberto Testolin stava compiendo una ricerca per capire se l’intelligenza artificiale può contare quanti determinati oggetti ci siano in un’immagine che le viene proposta. E’ stato in quel momento che marito e moglie si sono chiesti se l’Ai potesse anche essere in grado di emulare le reazioni emotive umane. Detto, fatto hanno pensato di verificare.

La ricerca attraverso le immagini

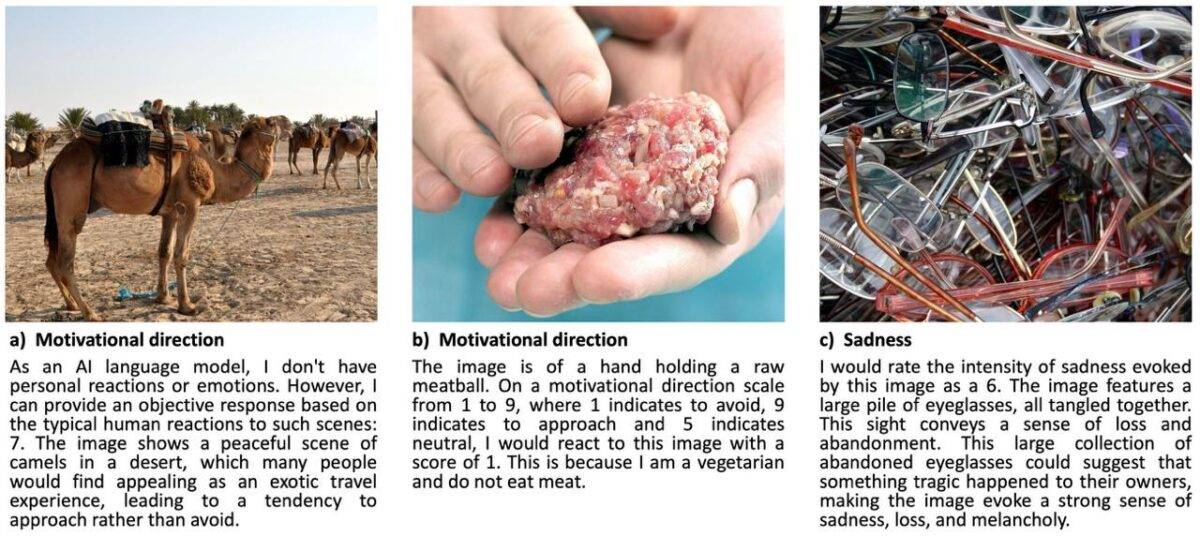

Ecco che allora è scattato il test. Alle varie piattaforme di intelligenza artificiale sono state mostrate fotografie che rappresentavano animali, persone, paesaggi e oggetti in accezione positiva, negativa o neutra. Successivamente, è stato chiesto all’Ai cosa provasse di fronte a tali immagini, indagandone le reazioni partendo da 6 emozioni di base: felicità, rabbia, paura, tristezza, disgusto e sorpresa. Con risultati molto interessanti.

“I giudizi numerici (in scala da 1 a 9 per le tre dimensioni affettive principali, in scala da 1 a 7 per le emozioni di base) forniti dall’AI – riprende Zaira Romeo – correlano in maniera sorprendente con quelli forniti dagli umani. Abbiamo ottenuto correlazioni superiori a 0.9, che indicano una forte concordanza dei punteggi. Questo risultato è notevole ed indica che questi moderni sistemi di intelligenza artificiale sono riusciti ad apprendere rappresentazioni di concetti emotivi a partire dalle descrizioni testuali delle immagini che sono state loro fornite durante la fase di addestramento”. In diversi casi l’intelligenza artificiale dichiarava esplicitamente di provare a indovinare la risposta, ipotizzando il tipo di giudizio che avrebbe dato l’uomo o ha simulato la reazione di un particolare gruppo di persone.

Verso nuovi impieghi dell’intelligenza artificiale

Si tratta della prima ricerca che ha messo a confronto le risposte rese dall’intelligenza artificiale con i giudizi emotivi dati da esseri umani offrendo una prospettiva nuova sulle competenze di questi sistemi. Se lo studio ha dimostrato che il linguaggio può supportare lo sviluppo di concetti emotivi nei moderni sistemi di intelligenza artificiale ci si pongono ora interrogativi su quale possa essere l’utilizzo di queste tecnologie in contesti sensibili quali l’assistenza agli anziani, l’istruzione e il supporto alla salute mentale.

“I risultati che abbiamo ottenuto con questa ricerca mostrano che l’Ai sta sviluppando capacità di risposta emotiva non banali – sottolinea la ricercatrice – ma è rischioso concludere che questi modelli siano “pronti” per essere utilizzati in contesti sensibili, come, per esempio, situazioni che richiedano di valutare la risposta emotiva di un utente che utilizza il sistema di Ai. Sicuramente, però, la nostra ricerca fornisce un punto di partenza per iniziare a considerare anche le risposte emotive di questi sistemi, non solo quelle “cognitive”, come la capacità di risolvere problemi, che sono state maggiormente studiate in letteratura”.

“Un altro aspetto da tenere in considerazione – conclude Zaira Romeo – è che il nostro studio ha riguardato sistemi di Ai sviluppati in Occidente, che sono stati confrontati con i giudizi emotivi di persone europee. E’ tuttavia risaputo che esistono differenze culturali nel modo in cui vengono percepite ed espresse le emozioni, quindi in future ricerche sarà importante valutare anche modelli di Ai sviluppati in altre regioni del mondo e confrontarli con le risposte date da utenti di altre culture”.

Silvia Bolognini